Wat is Antibot Cloud?

Gratis open-source PHP-script (GNU GPL v3) en cloudverwerkingsdiensten (API, SaaS-model) om websites te beschermen tegen kwaadaardige bots: voorkomt manipulatie van gedragsfactoren, vermindert serverbelasting, beschermt tegen spam, hackpogingen, brute-force-aanvallen en kwetsbaarheidsscans, scraping (parsing), proxyservers en contentdiefstal.

SEO-vriendelijk — veilig voor indexering en zoekmachineoptimalisatie. UX-vriendelijk — geen hinder voor bezoekers, waardoor CAPTCHA's op formulieren overbodig worden.

Antibot Cloud is geen AI-gegenereerd product en ook geen resultaat van zielloos vibe coding. Al meer dan 8 jaar wordt het gebouwd, verbeterd en onderhouden door echte mensen die er niet alleen hun kennis en ervaring in steken, maar ook hun hart.

Tariefplannen

ONE

$10 per maand

1 domein inclusief subdomeinen

Onbeperkte botcontroles

Bescherming van gedragsfactoren

10 dagen gratis uitproberen

Persoonlijke ondersteuning via e-mail

Persoonlijke ondersteuning via Telegram

Persoonlijke ondersteuning via WhatsApp

UNLIMITED

$1800 per jaar

Onbeperkt aantal beveiligde domeinen

Onbeperkte botcontroles

Bescherming van gedragsfactoren

Geen proefperiode

Persoonlijke ondersteuning via e-mail

Persoonlijke ondersteuning via Telegram

Persoonlijke ondersteuning via WhatsApp

FREE

Het Antibot-script (GNU GPL v3) met lokale controles en lokale filterregels is volledig gratis beschikbaar, zonder beperkingen of aanvullende voorwaarden. Bepaalde functies van het cloud-beheerpaneel zijn niet inbegrepen.

Standaard biedt het geen bescherming tegen gedragsmatige (browser)bots.

Geen persoonlijke ondersteuning — uitsluitend hulp via de community (forums, Telegram-groepen).

U stelt zelf lokale filterregels in op basis van land, stad, tijdzone, PTR, ASNum, ASName, User-Agent, browsertaal, subnetten of individuele IPv4- en IPv6-adressen, referrer en andere parameters.

Hoe werkt Antibot Cloud?

Toegang verlenen

Echte bezoekers

Echte bezoekers doorlopen een automatische controle en bereiken de website binnen 1 tot 3 seconden. De meeste bezoekers worden automatisch geverifieerd, zonder dat zij iets hoeven te doen. Wordt een bezoeker als verdacht aangemerkt, dan moet hij bevestigen dat hij geen robot is — door op een knop te drukken of een snelle CAPTCHA op te lossen.

Een bezoeker wordt slechts eenmalig gecontroleerd. Zolang de cookies bewaard blijven en de User-Agent of het IP-adres niet wijzigen — wat zelden voorkomt — vraagt Antibot niet om een nieuwe controle.

Zoekmachinecrawlers

Zoekmachinecrawlers (Googlebot, Bingbot enz.) krijgen toegang zonder extra controles en "zien" het Antibot-script niet actief. Hun echtheid wordt geverifieerd via het "IP-PTR-IP"-schema — nep-"zoekmachinebots" zakken voor de controle en worden geblokkeerd.

Gewenste bots

Via de regels kunt u de bots toestaan die u nodig hebt — u bepaalt zelf wie doorgelaten wordt en wie geblokkeerd. Voorbeelden van nuttige bots: PageSpeed Insights/Lighthouse, linkvoorbeeldbots (Telegram, Facebook, X) en andere sociale netwerken, RSS/feed-lezers...

Aangepaste regels

Voor verkeersfiltering kunt u aangepaste regels instellen — toegang verlenen of weigeren op basis van land en stad, tijdzone, PTR, ASNum/ASName, User-Agent, browsertaal, IP-adres, referrer en andere fingerprintparameters.

Toegang blokkeren

Spam

Spambots speuren automatisch contactformulieren, reacties, forums, registratiepagina's en andere invoervelden af om massaal spam, phishinglinks en schadelijke inhoud te versturen. Dit verstopt databases en e-mailboxen, tast de domeinreputatie aan, verlaagt de contentkwaliteit en verhoogt de serverbelasting.

Hackpogingen

Hackerbots scannen websites automatisch op kwetsbaarheden, zoeken naar beheerpanelen en veelgebruikte paden, proberen wachtwoorden te kraken via brute force en pogen XSS-, SQL-injectie-, bestandsupload- en andere zwakke plekken te misbruiken. De gevolgen kunnen zijn: injectie van kwaadaardige code en redirects, paginavervanging, verborgen SEO-spam, datalekken, dalingen in zoekresultaten en opname in zwarte lijsten. Antibot blokkeert zulke aanvallen direct aan de poort, filtert verdachte verzoeken en verkleint het risico op een hack.

Scraping

Scraping is het geautomatiseerd verzamelen en kopiëren van website-inhoud met behulp van bots. Doorway- en proxysites maken duplicaatpagina's aan, waardoor content minder uniek wordt in zoekmachines en de server extra belast wordt. Naast het kopiëren van tekst en afbeeldingen extraheren scrapers vaak catalogusgegevens — prijzen, productpagina's, links, contacten, e-mailadressen en andere openbare informatie — om deze op externe platforms of voor mailingcampagnes te gebruiken.

Gedragsbots en antidetectbrowsers

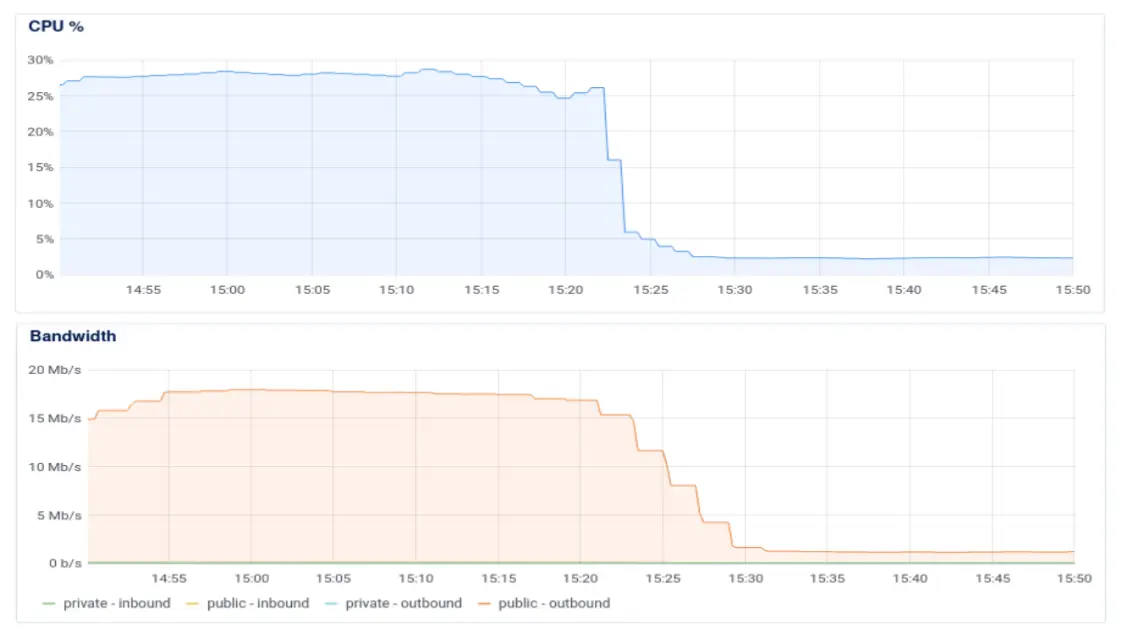

Gedragsbots vermommen zich als gewone bezoekers en imiteren "echte" acties op de website — paginaweergaven, scrollen, klikken en navigeren. Ze maken vaak gebruik van antidetectbrowsers, proxy's of VPN's en vervalsen browserfingerprints om eenvoudige filters te omzeilen. Het gevolg: vertekende analysegegevens, dalende CTR en conversieratio's, verspild advertentiebudget (klikfraude), een hogere bouncepercentage en verslechterde gedragsstatistieken.

Installatiehandleiding voor Antibot

Softwarevereisten: PHP 5.6 - 8.5.2, PHP-extensies (klassen): SQLite3, Mbstring, GMP, ZIP, GD, cURL, OpenSSL.

Download het installatieprogramma (het script antibot_installer.php) vanuit uw account. Mijn account.

Upload het installatieprogramma naar uw website (via SFTP) en open het in de browser via een adres zoals https://uw-site/antibot_installer.php

Voeg Antibot toe aan de benodigde scripts of uw CMS. Integratiemethoden.

Loopt u tegen problemen aan? Raadpleeg de documentatie (deze beantwoordt 95% van de veelgestelde vragen) of vraag professionele installatie en configuratie aan via de support (betaald of gratis). Documentatie. Installatie en configuratie aanvragen.